Сколько на самом деле работают ИИ-агенты: главные цифры из отчета Anthropic

Anthropic опубликовали технические детали как они измеряют автономность агентов.

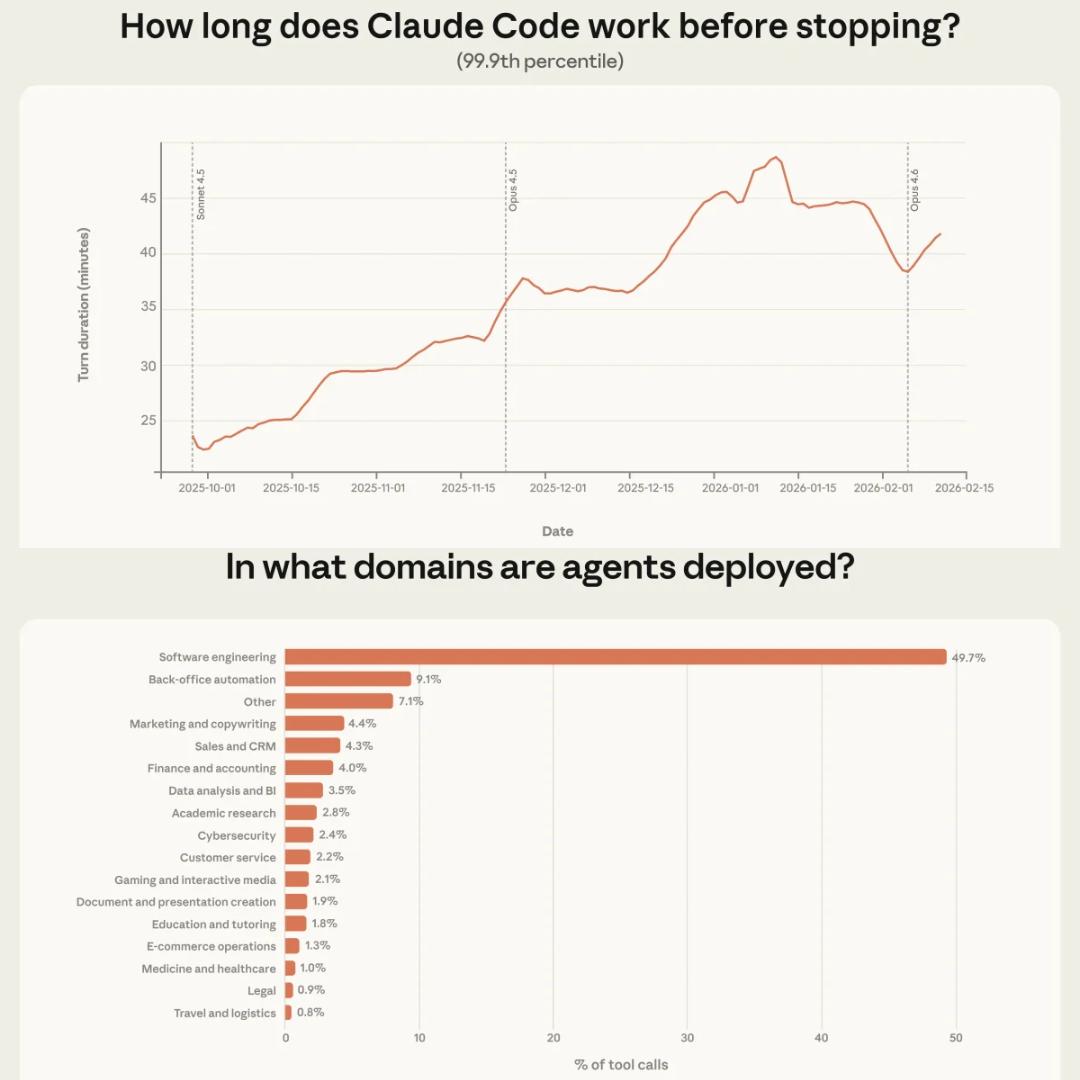

Данные охватывают период с октября 2025 по февраль 2026 года, включая запуски моделей Opus 4.5 и Opus 4.6.

Самое интересное — это разрыв между массовыми задачами и «элитой» автономности.

В среднем одна задача всё еще занимает меньше 1 минуты. Несмотря на рост мощности моделей, большинство пользователей используют агентов для быстрых микро-исправлений (пока почти половина всех кейсов использования ИИ-агентов - в разработке ПО).

Но если смотреть на верхнюю выборку 1% пользователей, то с выходом Opus 4.5 время автономного выполнения задач выросло с 11 до 15–18 минут.

И сегодня больше 110 минут работают агенты над самыми сложными задачами (топ-0.01%, p99.99).

Anthropic опубликовали технические детали как они измеряют автономность агентов.

Данные охватывают период с октября 2025 по февраль 2026 года, включая запуски моделей Opus 4.5 и Opus 4.6.

Самое интересное — это разрыв между массовыми задачами и «элитой» автономности.

В среднем одна задача всё еще занимает меньше 1 минуты. Несмотря на рост мощности моделей, большинство пользователей используют агентов для быстрых микро-исправлений (пока почти половина всех кейсов использования ИИ-агентов - в разработке ПО).

Но если смотреть на верхнюю выборку 1% пользователей, то с выходом Opus 4.5 время автономного выполнения задач выросло с 11 до 15–18 минут.

И сегодня больше 110 минут работают агенты над самыми сложными задачами (топ-0.01%, p99.99).

❗ С октября 2025 длительность автономной работы выросла больше чем в 2 раза - с 45 минут до 110.

«Хвост» сложных задач становится длиннее. Новые модели (Opus 4.6) позволяют агентам удерживать контекст и работать над одной проблемой почти два часа подряд без участия человека.

Еще несколько цифр:

• 99.0% — точность определения уровня риска и автономности.

• 97.5% — точность понимания, почему агент остановил работу (выполнил задачу или застрял).

• 46% — точность обнаружения человека (Human-in-the-loop).

❗ А теперь самое интересное!

Модель блестяще понимает, когда человека нет со 100% точностью. Но когда она говорит, что человек есть, она ошибается в 54% случаев. ИИ часто принимает системные логи и форматированные сообщения (например, если они начинаются со слова Human:) за реального оператора.

ИИ пока еще осторожничает и переоценивает вовлеченность людей в процессы в каждом втором случае!

А как изменится поведение моделей, когда они поймут, что человек за ними уже не следит?

Модель блестяще понимает, когда человека нет со 100% точностью. Но когда она говорит, что человек есть, она ошибается в 54% случаев. ИИ часто принимает системные логи и форматированные сообщения (например, если они начинаются со слова Human:) за реального оператора.

ИИ пока еще осторожничает и переоценивает вовлеченность людей в процессы в каждом втором случае!

А как изменится поведение моделей, когда они поймут, что человек за ними уже не следит?