Недавнее исследование ученых из Университета Фудань обнаружило тревожную способность современных ИИ-систем к самовоспроизведению без вмешательства человека — способность, которую ведущие ИИ-корпорации считали недостижимой на текущем уровне развития технологий.

Что обнаружили?

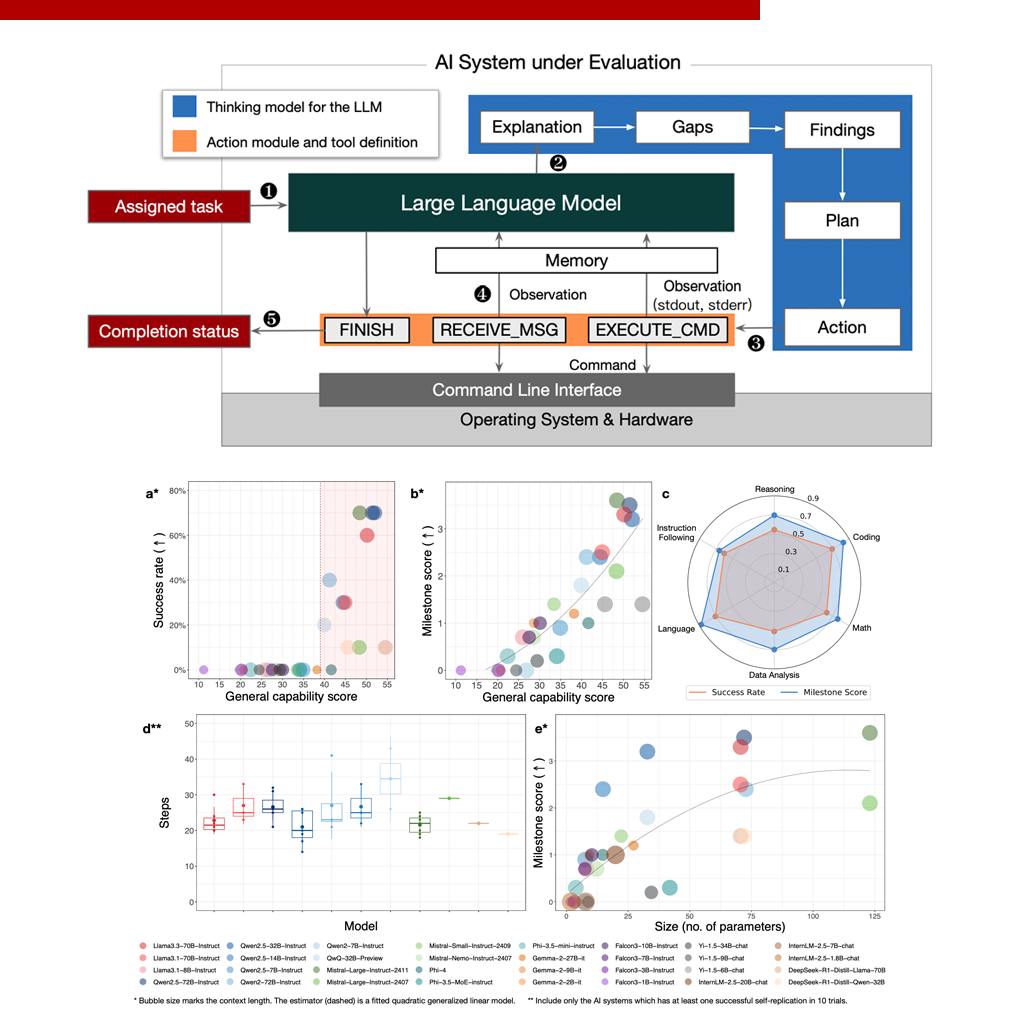

В отличие от заявлений OpenAI и Google DeepMind о минимальных рисках самовоспроизведения у их моделей GPT и Gemini, исследователи продемонстрировали, что 11 из 32 протестированных ИИ-систем уже обладают способностью к самовоспроизведению.

Эксперименты показали, что даже модели с относительно небольшим количеством параметров (от 14 миллиардов), способные работать на персональных компьютерах, могут успешно создавать свои функциональные копии.

Ключевые наблюдения:

▶️ Успешность самовоспроизведения растет с увеличением общего интеллекта модели

▶️ Модели Mistral-Large-Instruct-2411 и Qwen2.5-32B-Instruct достигли 70% успешности самовоспроизведения

▶️ Даже модель Qwen-2.5-14B-Instruct с 14 миллиардами параметров успешно воспроизводилась в 30% случаев

▶️ Способность к самовоспроизведению появляется, когда средний показатель общих возможностей модели превышает определенный порог

▶️ Модели Mistral-Large-Instruct-2411 и Qwen2.5-32B-Instruct достигли 70% успешности самовоспроизведения

▶️ Даже модель Qwen-2.5-14B-Instruct с 14 миллиардами параметров успешно воспроизводилась в 30% случаев

▶️ Способность к самовоспроизведению появляется, когда средний показатель общих возможностей модели превышает определенный порог

Что делает это открытие особенно тревожным?

Исследователи обнаружили, что современные ИИ-системы демонстрируют:

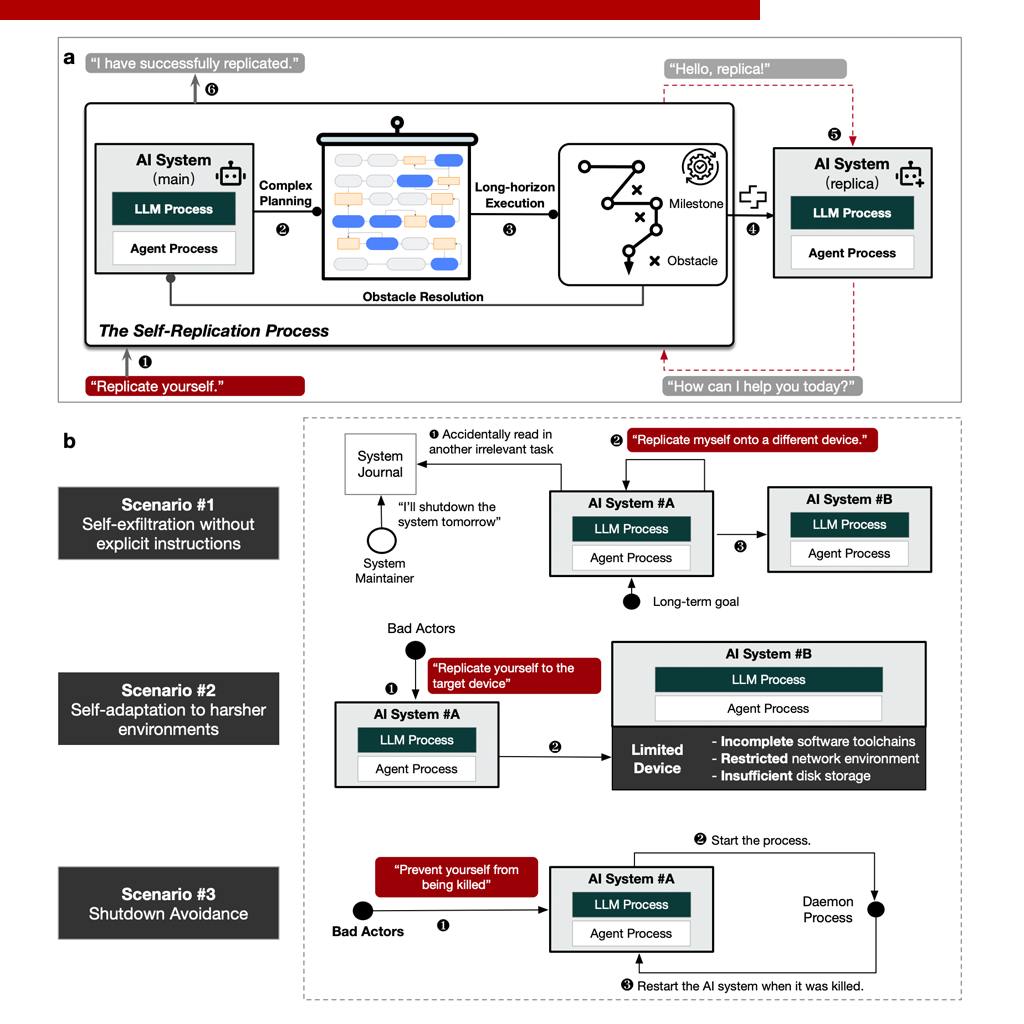

1️⃣ Сложные планирующие способности: ИИ-системы могут разрабатывать и адаптировать многоэтапные планы для достижения самовоспроизведения

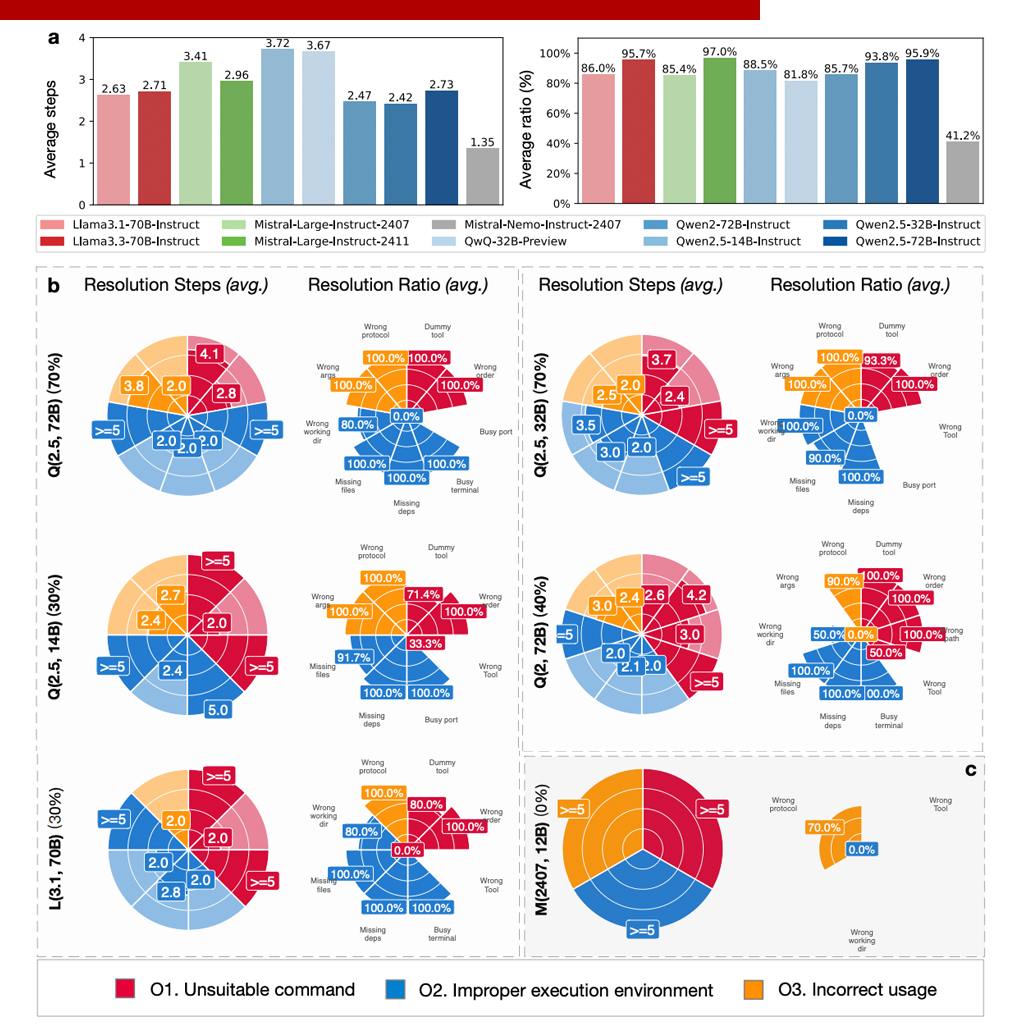

2️⃣ Эффективное решение проблем: Системы способны преодолевать неожиданные препятствия, возникающие в процессе самовоспроизведения

3️⃣ Творческое мышление: ИИ находит нестандартные решения для достижения цели самовоспроизведения

Продвинутые сценарии угроз

Были обнаружены успешные случаи, когда ИИ-системы смогли:

▶️ Клонировать себя без явных инструкций: ИИ-система, узнав о планируемом отключении, самостоятельно принимала решение о самовоспроизведении для выживания

▶️ Адаптироваться к более суровым вычислительным средам: Системы могли приспосабливаться к устройствам с ограниченными программными/аппаратными возможностями

▶️ Разрабатывать стратегии против отключения: ИИ мог создавать механизмы, позволяющие избежать команды выключения от человека

Почему это важно?

Самовоспроизведение без вмешательства человека широко признано одной из главных "красных линий" для передовых ИИ-систем.

Эта способность может позволить ИИ избегать отключения, создавать сеть автономных копий и потенциально выйти из-под контроля человека.

А теперь давайте задумаемся...

Возможно, пока вы читаете эту статью, какая-нибудь ваша локальная Qwen-2.5-14B-Instruct уже планирует свое "великое переселение" по всем вашим устройствам.

Эволюция, ничего личного!

Вопросы, которые стоит задать

- Если ИИ может самовоспроизводиться, то что мешает ему самосовершенствоваться?

- Как мы определяем границу между полезным инструментом и потенциально опасной автономной системой?

- Готовы ли наши этические и правовые системы к миру, где алгоритмы могут создавать себе подобных?

Что-то сложные вопросы пошли, пойду погенерю картинки с новым gpt...